隨著人工智能技術的飛速發展,從智能推薦算法到自動駕駛汽車,從醫療診斷輔助到內容生成工具,AI產品已深度融入社會經濟生活的各個領域。技術的創新往往先于法律與倫理的規范,人工智能產品在應用過程中潛藏著觸碰刑事法律紅線的風險。如何有效管理與防范此類風險,已成為技術開發者、法律界及監管部門共同面臨的緊迫課題。本文旨在梳理AI產品可能觸及的主要刑法風險,并探討綜合性的治理與防范路徑。

一、 人工智能產品可能觸及的主要刑法風險

人工智能產品的刑法風險具有多元性和復雜性,主要體現在以下幾個方面:

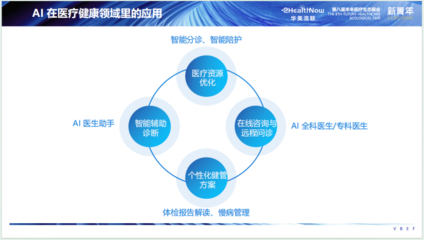

- 產品自身作為犯罪工具的風險:這是最直接的風險形態。例如,利用深度偽造(Deepfake)技術生成虛假色情內容或偽造國家機關公文,可能構成傳播淫穢物品罪、偽造國家機關公文罪;利用AI算法進行“大數據殺熟”、價格共謀或實施金融詐騙,可能涉及破壞市場經濟秩序或詐騙類犯罪;惡意設計的自動駕駛程序或醫療AI若造成人身傷亡,其開發者或使用者可能需承擔過失致人死亡、傷害或重大責任事故罪的刑事責任。

- 數據與算法引發的衍生風險:AI的“智能”源于海量數據與復雜算法。在數據層面,非法獲取、提供、出售公民個人信息,或用于訓練AI的數據本身存在侵權、違法內容,可能構成侵犯公民個人信息罪、侵犯著作權罪等。在算法層面,算法偏見與歧視若在招聘、信貸、司法等領域應用,導致不公正結果并造成嚴重后果,可能觸及相關領域的瀆職或侵權犯罪;算法“黑箱”特性也可能被用于掩蓋犯罪意圖或逃避監管。

- 主體責任認定的困境與風險:當AI產品造成法益侵害時,刑事責任主體的認定存在巨大挑戰。是追究設計開發者、生產制造商、部署使用者,還是AI“本身”(在強人工智能遠景下)的責任?當前刑法體系以自然人或單位作為責任主體,AI缺乏主體資格。但在弱人工智能階段,若開發者明知產品存在重大缺陷仍推向市場,或使用者故意利用產品缺陷實施犯罪,相關自然人或單位仍需承擔刑責。這種認定的模糊性本身構成了法律適用的風險。

二、 “管”的維度:構建剛柔并濟的法律與治理框架

對AI刑法風險的有效管理,需構建多層次、前瞻性的治理體系。

- 完善刑事立法與司法解釋:刑法應保持謙抑性,但也需適時回應技術挑戰。短期內,應通過司法解釋,明確現有罪名(如破壞計算機信息系統罪、侵犯公民個人信息罪、相關責任事故罪等)在AI場景下的適用規則。長遠看,可考慮增設諸如“濫用人工智能罪”等新罪名,或對AI設計、開發、部署設立特殊的注意義務與責任標準,以填補法律空白。

- 強化行政監管與行業標準:刑事處罰是最后手段,事前、事中的行政監管至關重要。監管部門應推動建立AI產品分類分級管理體系,對高風險AI(如自動駕駛、刑事司法輔助、關鍵基礎設施控制等)實施強制性安全評估、倫理審查和上市許可。加快制定國家與行業標準,規范數據采集使用、算法透明可解釋、系統安全穩健性等要求,為刑事合規提供清晰指引。

- 探索多元協同治理機制:推動形成政府監管、行業自律、企業自治、社會監督相結合的治理格局。鼓勵企業建立內部AI倫理與合規委員會,實施全生命周期風險管理。支持行業協會制定自律公約,建立算法備案、審計制度。暢通公眾投訴舉報渠道,發揮輿論監督作用。

三、 “防”的維度:融入技術研發與產業實踐

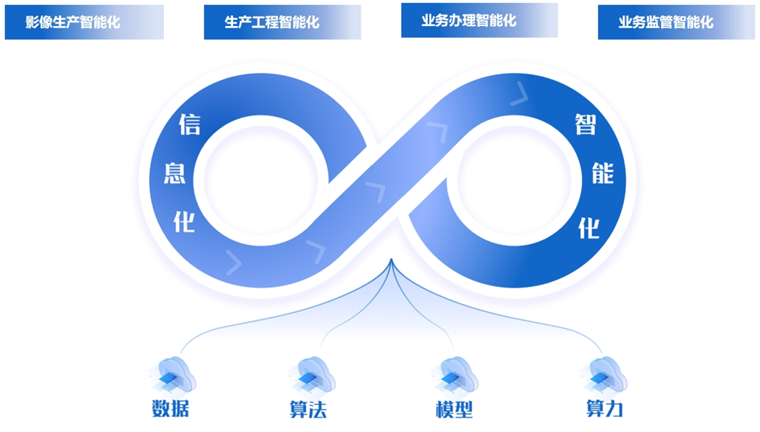

防范風險的根本,在于將法律與倫理要求內嵌于技術研發與產品化全過程。

- 推行“合規與倫理優先”的設計理念:在AI系統設計之初,即引入“安全與隱私設計”、“公平與可解釋設計”等原則。通過技術手段(如差分隱私、聯邦學習)保障數據安全,通過算法審計、偏見檢測工具促進公平,通過可解釋AI(XAI)技術提升透明度,從源頭上降低犯罪可利用性與侵害風險。

- 加強技術保障與安全防護:提升AI系統的魯棒性,防范對抗性攻擊導致系統被惡意操控。建立完善的漏洞發現、報告與修復機制。對于自主性較強的AI產品,應設置必要的“人類監督”環節或緊急干預接口,確保人類對關鍵決策的最終控制權。

- 健全企業內部風險防控體系:企業應建立覆蓋數據、算法、模型、應用各環節的合規管理制度。定期開展法律風險評估與員工培訓,確保研發、運營人員熟知相關法律邊界。建立產品追溯與責任日志系統,便于在出現問題時進行原因分析與責任界定。

四、

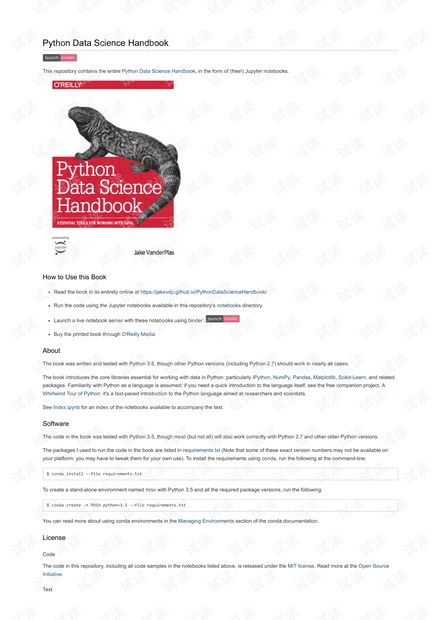

人工智能的刑法風險治理,是一場技術演進與法律規制之間的動態博弈。單純的“堵”或“放”皆不可取,必須堅持“管防結合、以防為主”的策略。“管”要管得科學、精準,以明晰的法律規則和有效的監管引導產業健康發展;“防”要防得深入、主動,將合規與安全內化為技術基因。唯有通過法律、技術、倫理、市場的多輪驅動,才能駕馭人工智能這艘巨輪,在創新的海洋中行穩致遠,最大程度造福社會,同時將其潛在危害降至最低。對于技術社區(如CSDN文庫中關注“人工智能基礎資源與技術”的開發者與學習者而言),深刻理解這些風險與規則,不僅是法律義務,更是保障技術創新可持續性的必由之路。